上周,chatgpt背后的神秘公司openai似乎被攻破了。公司董事会突然解雇了首席执行官山姆•奥特曼(Sam Altman),数百名员工造反抗议,奥特曼复职,媒体从各个可能的角度剖析了这件事。然而,这些报道掩盖了一个事实,即我们对该公司最关键部分的看法仍然非常有限:我们并不真正了解OpenAI是如何开发其技术的,也不确切了解奥特曼是如何指导未来更强大的一代的工作的。

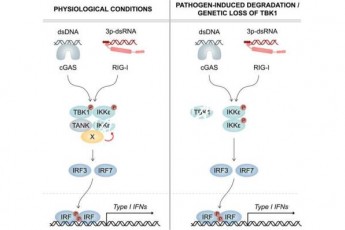

上周三,路透社(Reuters)和The Information报道称,在奥特曼被解雇之前,几名研究人员对一项所谓的危险突破表示了担忧,这一点非常明显。争论的焦点是一种名为Q*(发音为“Q-star”)的算法,据称该算法被证明可以解决某些以前从未见过的小学水平的数学问题。虽然这听起来可能没什么了不起,但据报道,该公司的一些研究人员认为,这可能是该算法提高推理能力的早期迹象——换句话说,就是利用逻辑来解决新问题。

数学通常被用作这项技能的基准;研究人员很容易定义一个新问题,从理论上讲,找到一个解决方案应该需要掌握抽象概念,以及一步一步的计划。这种推理方式被认为是更智能、更通用的人工智能系统(OpenAI称之为“通用人工智能”)所缺失的关键要素之一。根据该公司的说法,这样一个理论系统在大多数任务中都比人类更好,如果控制不当,可能会导致生存灾难。

OpenAI的一位发言人没有对Q*发表评论,但他告诉我,研究人员的担忧并没有促使董事会采取行动。两名熟悉该项目的人士向我证实,OpenAI确实一直在研究该算法,并将其应用于数学问题。由于担心受到影响,这两名人士要求匿名。但与他们的一些同事的担忧相反,他们表示怀疑,这可能被认为是一个了不起的突破,足以引发存在的恐惧。他们的怀疑凸显了人工智能研究长期以来的一个事实:人工智能的进步在发生的那一刻往往是高度主观的。一个特定的算法或一项研究是否真的是一个突破,需要很长时间才能形成共识,因为越来越多的研究人员建立并证实了这个想法是多么的可复制、有效和广泛适用。

以转换器算法为例,它支持大型语言模型和ChatGPT。当谷歌研究人员在2017年开发出这种算法时,它被视为一项重要的发展,但很少有人预测到它会成为今天生成式人工智能的基础和重要因素。直到OpenAI用大量的数据和计算资源对算法进行了强化,其他行业才开始效仿,用它来推动图像、文本,现在甚至是视频生成的界限。

在人工智能研究中,实际上,在所有科学中,思想的兴衰并不是基于纯粹的精英管理。通常,拥有最多资源和最大扬声器的科学家和公司发挥最大的影响力。围绕这些实体形成共识,这实际上意味着它们决定了人工智能的发展方向。在人工智能行业,权力已经集中在少数几家公司手中——meta、谷歌、OpenAI、微软和Anthropic。这种不完美的建立共识的过程是我们所拥有的最好的,但它正变得更加有限,因为研究曾经大部分是公开进行的,现在是秘密进行的。

在过去的十年里,随着大型科技公司意识到人工智能技术的巨大商业化潜力,它们提供了丰厚的薪酬,从大学挖走学者。许多人工智能博士候选人不再等待获得学位后才加入企业实验室;许多留在学术界的研究人员从同一家公司获得资助,甚至是双重任命。现在,许多人工智能研究都发生在科技公司内部或与科技公司有关,这些公司被激励隐藏自己最好的进步,以便更好地与商业对手竞争。

OpenAI认为,其保密的部分原因是,任何可能加速超级智能发展的东西都应该小心翼翼地加以保护;它说,不这样做可能会对人类构成威胁。但该公司也公开承认,保密可以让它保持竞争优势。“开发GPT-4并不容易,”OpenAI的首席科学家伊利亚·苏斯克维尔(Ilya Sutskever)今年3月告诉The Verge。“OpenAI的所有成员花了很长时间才制作出这个东西。还有很多很多公司也想做同样的事情。”

自从Q*的消息传出以来,OpenAI之外的许多研究人员都在猜测,这个名字是否参考了该领域的其他现有技术,比如Q-learning,一种通过反复试验来训练AI算法的技术,以及a *,一种通过一系列选项搜索以找到最佳算法的算法。OpenAI的发言人只会说,该公司一直在做研究,并致力于新的想法。没有额外的知识,也没有机会让其他科学家随着时间的推移来证实Q*的健壮性和相关性,所有人(包括参与该项目的研究人员)所能做的就是假设它实际上有多大——并认识到突破这个词不是通过科学共识达成的,而是由一小群员工根据自己的意见分配的。