近日,AI视频生成工具Sora被从“弹药库”中拿出来,瞬间占据各大新闻头条。

就连一向不对抗的马斯克也愿意承认Sora的力量并称赞它,“未来几年,人类将借助AI的力量创造出优秀的作品。”

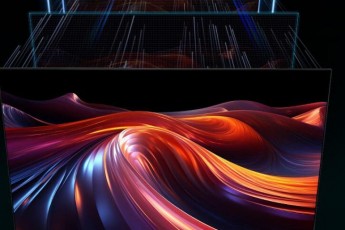

Sora的强大之处在于它能够根据文字描述生成长达60秒的连贯流畅的视频,其中包含细腻复杂的场景、生动的人物表情和复杂的镜头动作。

与其他只能生成个位数短视频的视频相比,Sora 的一分钟时长无疑具有翻盘的效果。

更重要的是,Sora无论在视频真实性、长度、稳定性、一致性、分辨率还是文本理解方面都展现出了最好的水平。 首先让我们欣赏一下官方发布的演示视频片段。

:,白雪皑皑的东京城。 动城,白雪皑皑。 都是风一起。

在这段视频中,从无人机的角度看到一对夫妇走过繁忙的城市街道,美丽的樱花花瓣在雪花的陪伴下在空中翩翩起舞。

当其他工具还在努力保持单镜头稳定的时候,Sora已经顺利实现了多镜头的无缝切换,而且镜头切换的连贯性和物体的一致性都遥遥领先,这是真正的降维打击。

▲来自@gabor

过去,拍摄这样的视频可能需要花费大量的时间和精力进行剧本创作、镜头设计等一系列繁琐的工作。 现在,只需要简单的文字描述,空就完全可以产生如此大的场面,相关的从业者恐怕已经开始颤抖了。

网友@使用Sora剪辑、Labs上David的声音以及上面的一些自然音乐样本,在15分钟内制作了这个20秒的预告片。

Sora是如何发挥其强大功效的呢?

同时还发布了Sora的详细技术报告,介绍了其背后的技术原理和应用。

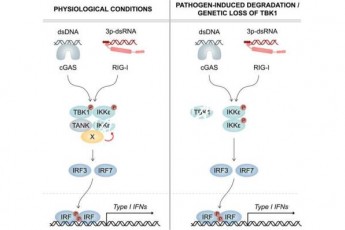

那么,Sora是如何实现这一突破的呢? 受LLM成功实践经验的启发,引入了视觉块嵌入代码(),它是一种高度可扩展且有效的视觉数据表示,可以大大提高生成模型处理多样化视频和图像数据的能力。

在高维空间中,视频数据首先被压缩到低维潜在空间,然后分解为时空嵌入,从而将视频转换为一系列编码块。

接下来,训练了专门设计用于降低视觉数据维度的网络。 该网络将原始视频作为输入,并输出在时间和空间上都被压缩的潜在表示。 Sora 正是在这个压缩的潜在空间中接受训练并在该空间内生成视频。

此外,还训练了一个解码器模型,可以将这些潜在表示恢复为像素级视频图像。

通过处理压缩视频输入,研究人员能够提取在模型中发挥类似作用的一系列空间和时间。

使用基于Sora的表达式,它可以适应不同分辨率、时长和长宽比的视频和图像。 在生成新的视频内容时,它可以通过将这些随机初始化的图像按照所需的大小排列成网格来控制最终结果。 视频的大小和格式。

虽然上面的原理听起来相当复杂,但事实上,所使用的新技术——视觉块嵌入代码(简称视觉块)——就像把一堆杂乱无章的积木组织到一个小盒子里。 这样,即使积木有很多,只要找到这个小盒子,就可以轻松找到自己需要的积木。

由于视频数据被转换为小方块,所以当Sora被赋予新的视频任务时,他们会首先从视频中提取一些包含时间和空间信息的小方块。 然后将这些小方块交给 Sora,以根据这些信息生成新视频。

这样,视频就可以像拼图一样重新拼凑起来。 这样做的好处是计算机可以更快地学习和处理各种不同类型的图片和视频。

随着Sora的训练越来越深入,研究人员还发现,随着训练计算量的增加,样本质量显着提高。 我们发现直接对原始大小的数据进行训练有几个优点:

此外,Sora还具有以下特点:

训练文本到视频生成系统需要大量带有文本字幕的视频。 将DALL·E 3中引入的重新注释技术应用于视频。

与DALL·E 3类似,GPT用于将用户的简短提示转换为较长的详细指令,然后将其发送到视频模型,从而使Sora能够生成高质量的视频。

除了从文本进行转换之外,Sora 还可以接受来自图像或现有视频的输入。 该功能使Sora能够完成各种图像和视频编辑任务,例如制作无缝循环视频、为静态图像添加动画效果、延长视频的播放时间等。

云朵的逼真图像形成了“SORA”一词。

一座装饰华丽的历史大厅里,一股巨大的浪潮即将袭来。 两位冲浪者抓住了这个机会,熟练地驾驭着海浪。

Sora 无需任何事先示例即可更改视频中的风格和环境。 即使是两个风格完全不同的视频也能顺利连接。

Sora还可以生成图像,研究团队通过在时间尺度仅为一帧的空间网格中排列高斯噪声块来创建各种尺寸的图像,直至达到最大分辨率。

Real也坦言Sora目前的局限性,比如无法模拟复杂场景的物理效果,无法理解某些因果关系。 例如,它无法准确模拟玻璃破碎等基本物理交互。

▲反方向跑

但我坚信,Sora 目前的能力表明,视频模型的持续扩展是开发能够模拟物理和数字世界以及其中的物体、动物和人类的模拟器的一条有前途的道路。

世界模型,AI的下一个方向?

研究发现,在大规模训练下,Sora表现出了一系列惊人的突现能力,可以在一定程度上模拟现实世界的人、动物和环境。

这些能力并不是基于三维空间或物体的特定预设,而是由大规模数据驱动。

将 Sora 视为“能够理解和模拟现实世界的模型的基础”,并相信其能力“将成为实现 AGI 的重要里程碑”。

对于Sora的到来,高级科学家Jim Fan表示:

如果你认为 Sora 是一个创造性实验的工具,就像 DALL·E 一样,你可能需要重新考虑。

Sora实际上是一个基于数据的物理模拟引擎,可以模拟真实或虚构的世界。 该模拟器通过去噪和梯度计算学习复杂的图像渲染、“直观”的物理行为、长期规划能力以及语义级别的理解。

这个模型能力的基础是世界通用模型,也就是人工智能系统。 其目标是构建一个可以更新状态以记忆和建模环境的神经网络模块。

该模型能够根据当前观察(例如图像、状态等)和即将采取的行动来预测下一个可能的观察。 它通过学习世界的规律和常识来模拟环境中未来可能发生的事件。

事实上,世界模式并不是一个新概念。 早在去年12月,AI视频生成领军企业就正式宣布将构建通用世界模型。 目的是创建一种不同于现有LLM并且能够更真实地模拟的LLM。 现实世界的人工智能系统。

具体来说,世界模型的核心思想是通过记忆历史经验来学习世界如何运行,进而预测未来可能发生的事件。 例如,从物体下落的视频中,模型可以根据当前图片预测下一帧,从而学习物体运动的物理规律。

图灵奖获得者Yann LeCun也提出了类似的概念,并批评了基于概率生成自回归的大型模型,例如GPT,认为此类模型无法解决幻觉问题。 LeCun 和他的团队甚至预测像 GPT 这样的模型可能会在未来五年内过时。

世界模型可以被视为人工智能领域的一个研究方向,试图创造更接近人类智能水平的AI。 通过模拟和学习现实世界的环境和事件,世界模型有潜力推动人工智能迈向更高水平的模拟和预测能力。

今年2月,知名风投公司a16z合伙人摩尔对AI视频生成领域的现状进行了深入分析。 生成式AI逐渐走进大众视野的两年来,AI视频生成领域迎来了百花齐放、百家争鸣的繁荣景象。

随着Sora的加入,AI视频生成领域将掀起巨大浪潮,现有主流平台如Pika、Video等可能会受到影响。

与此同时,独立创作者的游戏规则将彻底改变。 任何有创造力和想法的人都可以使用 Sora 生成自己的视频内容。 创作门槛的降低也意味着独立创作者将迎来黄金时代。

正如《三体》中所说,“没关系”。 无论当前的竞争状况如何,AI视频生成领域都可能被新技术和创新所颠覆。 而Sora的进入只是开始,远未结束。